-

PLUS

8 smarta tips för Google Foto – Ta kontroll över bilderna i påsk

-

PLUS

Krönika: Nej AI, jag vill inte vara din kompis eller partner

-

PLUS

Kommentar: Hindren som stoppar Tre

-

PLUS

Tips: 8 knep till Googles anteckningsapp Keep

-

PLUS

Apple Intelligence påminner mig om något betydligt bättre

-

PLUS

Mobils stora guide till Apple Intelligence i Iphone

-

PLUS

Krönika: Mobiltillverkare för första gången, igen

-

PLUS

11 tips: Google-appen som kan mycket mer än du tror

-

PLUS

Krönika: Google är bra på gratis men usla på att ta betalt

-

PLUS

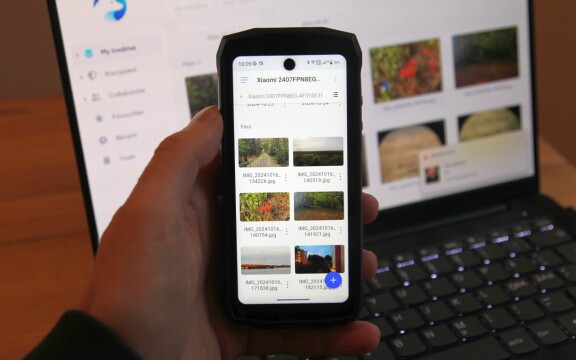

Så kan Xiaomi-telefonen bli Mac-datorns och Iphones bästa vän

Ändrar policy och storsatsar

Google kan skapa AI för vapen

Google öppnar upp för att använda AI för vapen och övervakningsteknik, samtidigt som man storsatsar på AI-utveckling.

Enligt publikationen Washington Post har Google nyligen uppdaterat sin policy för artificiell intelligens. Sedan 2018 har företagets policy uttryckligen angett att Google inte skulle utveckla eller distribuera AI för användning i vapen eller övervakningsteknik. Denna specifika formulering har nu tagits bort.

I stället har Google infört en ny policy där de betonar att de kommer att "implementera lämplig mänsklig tillsyn, tillbörlig aktsamhet och återkopplingsmekanismer för att anpassa sig till användarmål, socialt ansvar och allmänt accepterade principer för internationell rätt och mänskliga rättigheter."

Samtidigt planerar Googles moderbolag Alphabet att investera 75 miljarder dollar, motsvarande över 800 miljarder kronor, i AI under 2025. Investeringen förväntas främst användas för att bygga ut infrastrukturen för artificiell intelligens.

Det är inte första gången som Googles engagemang i militära eller övervakningsprojekt har väckt uppmärksamhet. År 2018 mötte företaget intern kritik efter att det framkom att de samarbetade med Pentagon på ett projekt kallat Project Maven, som använde AI för att analysera drönarbilder. Efter protester från tusentals anställda beslutade Google då att inte förnya kontraktet och införde policyn mot att utveckla AI för vapenändamål.

Den senaste policyändringen har därför väckt frågor om Google nu öppnar upp för att återigen medverka i projekt av den typen. Företaget har ännu inte kommenterat detaljerna kring ändringen, men betoningen på mänsklig tillsyn och efterlevnad av internationell rätt kan tyda på en mer nyanserad inställning till hur deras teknik används.